黑马程序员技术交流社区

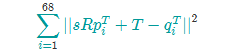

标题: 【上海校区】教你用200行Python代码“换脸” [打印本页]

作者: wuqiong 时间: 2018-5-25 17:11

标题: 【上海校区】教你用200行Python代码“换脸”

本帖最后由 wuqiong 于 2018-5-25 17:14 编辑

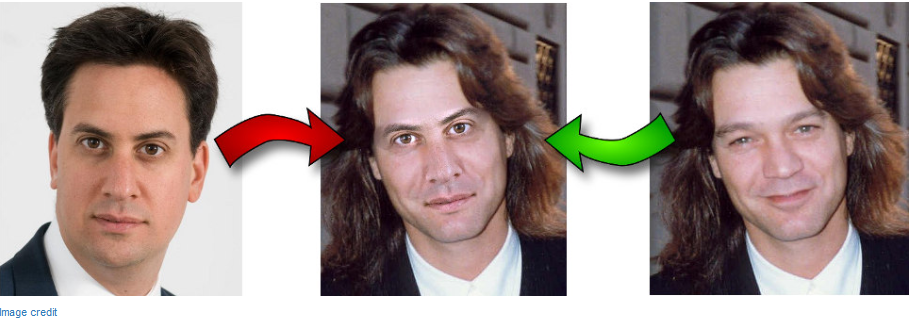

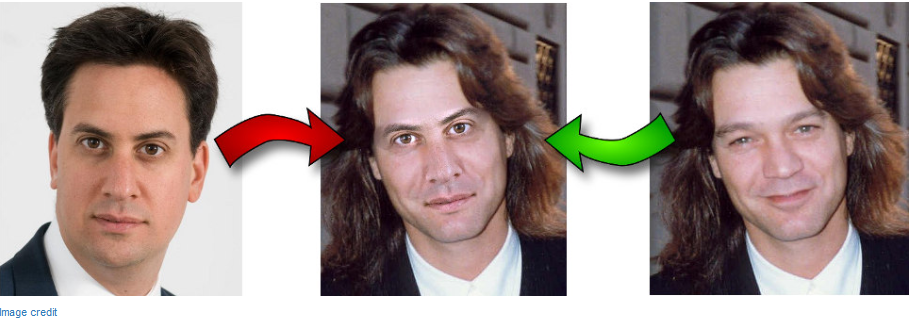

介绍本文将介绍如何编写一个只有200行的Python脚本,为两张肖像照上人物的“换脸”。

这个过程可分为四步:

- 检测面部标记。

- 旋转、缩放和转换第二张图像,使之与第一张图像相适应。

- 调整第二张图像的色彩平衡,使之与第一个相匹配。

- 把第二张图像的特性混合在第一张图像中。

1.使用dlib提取面部标记

该脚本使用dlib的Python绑定来提取面部标记:

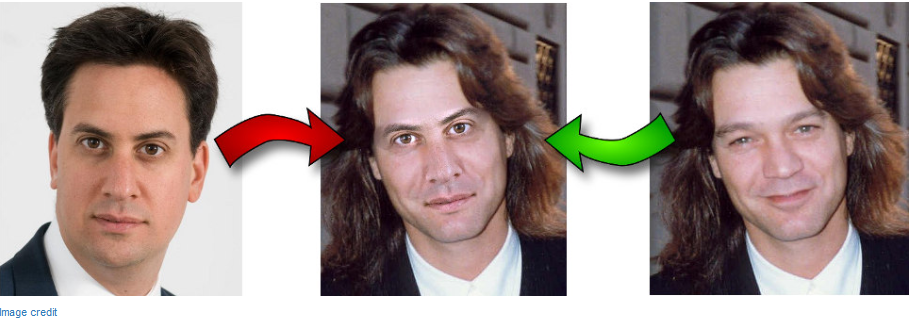

get_landmarks()函数将一个图像转化成numpy数组,并返回一个68 x2元素矩阵,输入图像的每个特征点对应每行的一个x,y坐标。

特征提取器(predictor)要一个粗糙的边界框作为算法输入,由传统的能返回一个矩形列表的人脸检测器(detector)提供,其每个矩形列表在图像中对应一个脸。

2.用普氏分析(Procrustes analysis)调整脸部

现在我们已经有了两个标记矩阵,每行有一组坐标对应一个特定的面部特征(如第30行给出的鼻子的坐标)。我们现在要搞清楚如何旋转、翻译和规模化第一个向量,使它们尽可能适合第二个向量的点。想法是,可以用相同的变换在第一个图像上覆盖第二个图像。

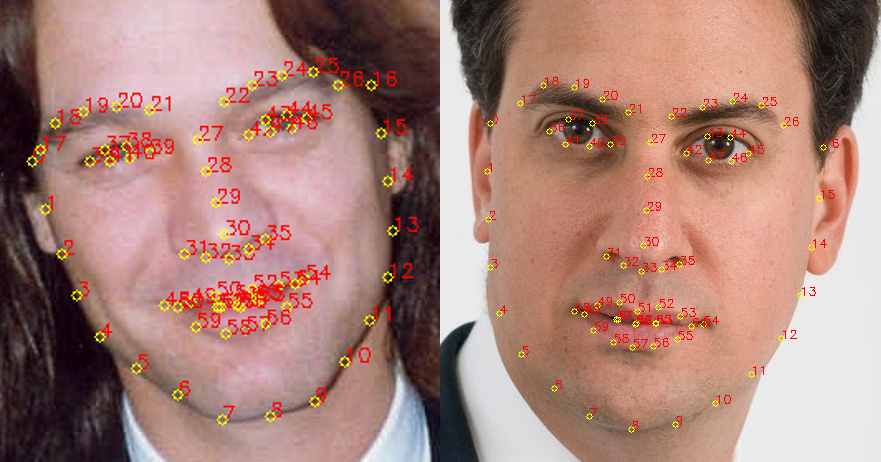

把它们更数学化,寻找T,s和R,令下面这个表达式的结果最小:

R是个2 x2正交矩阵,s是标量,T是二维向量,pi和qi是上面标记矩阵的行。

事实证明,这类问题可以用“常规普氏分析法” (Ordinary Procrustes Analysis) 解决:

def transformation_from_points(points1, points2): points1 = points1.astype(numpy.float64) points2 = points2.astype(numpy.float64) c1 = numpy.mean(points1, axis=0) c2 = numpy.mean(points2, axis=0) points1 -= c1 points2 -= c2 s1 = numpy.std(points1) s2 = numpy.std(points2) points1 /= s1 points2 /= s2 U, S, Vt = numpy.linalg.svd(points1.T * points2) R = (U * Vt).T return numpy.vstack([numpy.hstack(((s2 / s1) * R, c2.T - (s2 / s1) * R * c1.T)), numpy.matrix([0., 0., 1.])])代码分别实现了下面几步:

之后,结果可以插入OpenCV的cv2.warpAffine函数,将图像二映射到图像一:

def warp_im(im, M, dshape): output_im = numpy.zeros(dshape, dtype=im.dtype) cv2.warpAffine(im, M[:2], (dshape[1], dshape[0]), dst=output_im, borderMode=cv2.BORDER_TRANSPARENT, flags=cv2.WARP_INVERSE_MAP) return output_im图像对齐结果如下:

3.校正第二张图像的颜色

如果我们试图直接覆盖面部特征,很快就会看到一个问题:

两幅图像之间不同的肤色和光线造成了覆盖区域的边缘不连续。我们试着修正:

结果是这样:

此函数试图改变图像2的颜色来匹配图像1。它通过用im2除以im2的高斯模糊,然后乘以im1的高斯模糊。这里的想法是用RGB缩放校色,但是不是用所有图像的整体常数比例因子,每个像素都有自己的局部比例因子。

用这种方法两图像之间光线的差异只能在某种程度上被修正。例如,如果图像1是从一边照亮,但图像2是均匀照明的,色彩校正后图像2也会出现未照亮边暗一些的现象。

也就是说,这是一个相当粗糙的办法,而且解决问题的关键是一个适当的高斯内核大小。如果太小,第一个图像的面部特征将显示在第二个图像中。过大,内核之外区域像素被覆盖,并发生变色。这里的内核用了一个0.6 *的瞳孔距离。

4.把第二张图像的特性混合在第一张图像中

用一个遮罩来选择图像2和图像1的哪些部分应该是最终显示的图像:

值为1(白色)的地方为图像2应该显示出的区域,值为0(黑色)的地方为图像1应该显示出的区域。值在0和1之间为图像1和图像2的混合区域。

这是生成上面那张图的代码:

我们把上述代码分解:

get_face_mask()的定义是为一张图像和一个标记矩阵生成一个遮罩,它画出了两个白色的凸多边形:一个是眼睛周围的区域,一个是鼻子和嘴部周围的区域。之后它由11个像素向遮罩的边缘外部羽化扩展,可以帮助隐藏任何不连续的区域。

这样一个遮罩同时为这两个图像生成,使用与步骤2中相同的转换,可以使图像2的遮罩转化为图像1的坐标空间。

之后,通过一个element-wise最大值,这两个遮罩结合成一个。结合这两个遮罩是为了确保图像1被掩盖,而显现出图像2的特性。

最后,应用遮罩,给出最终的图像:

output_im = im1 * (1.0 - combined_mask) + warped_corrected_im2 * combined_mask

作者: 吴琼老师 时间: 2018-7-5 16:48

作者: 不二晨 时间: 2018-7-10 14:56

奈斯

作者: wuqiong 时间: 2018-7-12 15:41

| 欢迎光临 黑马程序员技术交流社区 (http://bbs.itheima.com/) |

黑马程序员IT技术论坛 X3.2 |